やっほー!TKちゃんだよ!チャリティとAIの意外な関係に迫るよ!

みんな、SNSやネットのニュースで、困っている子どもや自然環境の保護を呼びかける「チャリティ広告」を見たことあるよね?すごく心を打たれる写真が使われていることが多いけど、最近あのなかに「AIで作られた画像」が混ざっていることがあるんだ。

「AIを使えば、お金も時間もかけずに、みんなの共感を呼ぶ最高の一枚が作れるじゃん!」って思うかもしれないよね。でもね、イギリスのイースト・アングリア大学(UEA)の最新研究で、この「AIによる共感への近道」が、実は慈善団体にとって超危険な落とし穴になっていることが分かったんだ!

今日は、AIと人間の心、そして「本物の共感」について、データをもとにたっぷり掘り下げていくよ!知的好奇心がくすぐられること間違いなし!それじゃあ、TKちゃんの科学実験ラボ、スタートだよ!

なぜチャリティ団体はAI画像を使い始めたの?(研究の背景)

世界中には、飢餓や病気、自然災害などで苦しんでいる人たちがたくさんいるよね。アムネスティ・インターナショナルやWHO(世界保健機関)、WWF(世界自然保護基金)といった大きな慈善団体は、そんな現状をみんなに知ってもらって、支援の輪を広げるためにキャンペーンを行っているんだ。

でも、紛争地域や被災地にカメラマンを派遣して、安全を確保しながら写真を撮るのって、すごくお金も時間もかかるんだよね。しかも、実際の被害者の顔をそのまま世界中に公開することは、プライバシーや人権の保護の観点から「対象者の搾取にならないか?」っていう難しい倫理的な問題もあるんだ。

そこで救世主として登場したのが、みんなもよく知っている生成AI!AIを使えば、リアルで心を打つ画像を、安全に、しかも一瞬で作り出すことができる。「これならコストも抑えられるし、誰のプライバシーも傷つけずに支援を呼びかけられる!」って、多くの団体が期待してAI画像を導入し始めたっていう背景があるんだよ。

大規模な調査!AI画像を見た人々の反応を徹底分析!(実験内容・調査方法)

じゃあ、実際にAI画像を見た人たちはどう感じたのか?UEAの研究チーム(デイビッド・ギリング氏やデボラ・アデシナ氏たち)は、「Artificial Authenticity(人工的な真実性)」というレポートをまとめるために、すごく大規模な調査を行ったんだ。

研究チームは、17の主要な慈善団体が実際にキャンペーンで使用した171件のAI生成画像をピックアップ!さらに、それらの画像に対してSNSなどで寄せられた400件以上の一般の人々のコメントを、一つ一つ丁寧に分析していったんだ。

つまり、「AIが作った支援を呼びかける画像に対して、世間の人々はどんな言葉を返し、どんな行動をとったのか」という、リアルな反応のデータを集めたってわけ!人間の心理がそのままネットの海に現れているんだから、こういう社会科学的なアプローチってすごくワクワクするよね!

驚きの結果!支援の話題が消滅しちゃった!?

さあ、ここからがビックリするような結果だよ!普通なら、「かわいそう」「私にも何かできないかな」「寄付しよう」っていうコメントが集まると思うよね?でも、データが示した現実は全く違っていたんだ。

なんと、分析した400件以上のコメントのうち、本来の目的である「慈善活動そのもの」や「人道支援の課題」について語っていたのは、たったの80件(全体の20%未満)しかなかったの!これって衝撃的じゃない?

じゃあ、残りの80%以上の人たちは何を話していたのか?実は、「これってAIが作った偽物の画像じゃない?」「こんなフェイク画像を使って寄付を集めるなんて倫理的にどうなの?」「指の形がおかしいからAI確定だね」みたいな、画像そのものの真偽や、AI技術への批判ばかりに議論が集中してしまったんだよ!

つまり、AI画像を使った瞬間に、一番伝えたかったはずの「支援を必要としている人たちの物語」が、みんなの意識からすっぽり抜け落ちてしまったんだ。AIが本来のメッセージを覆い隠すノイズになっちゃったなんて、チャリティ団体にとってはまさに本末転倒な結果だよね!

なぜそうなったの?「共感」の科学的メカニズム

どうしてこんなすれ違いが起きちゃったんだろう?そこには、僕たち人間の「共感(エンパシー)」という感情の深いメカニズムが関係しているんだ。

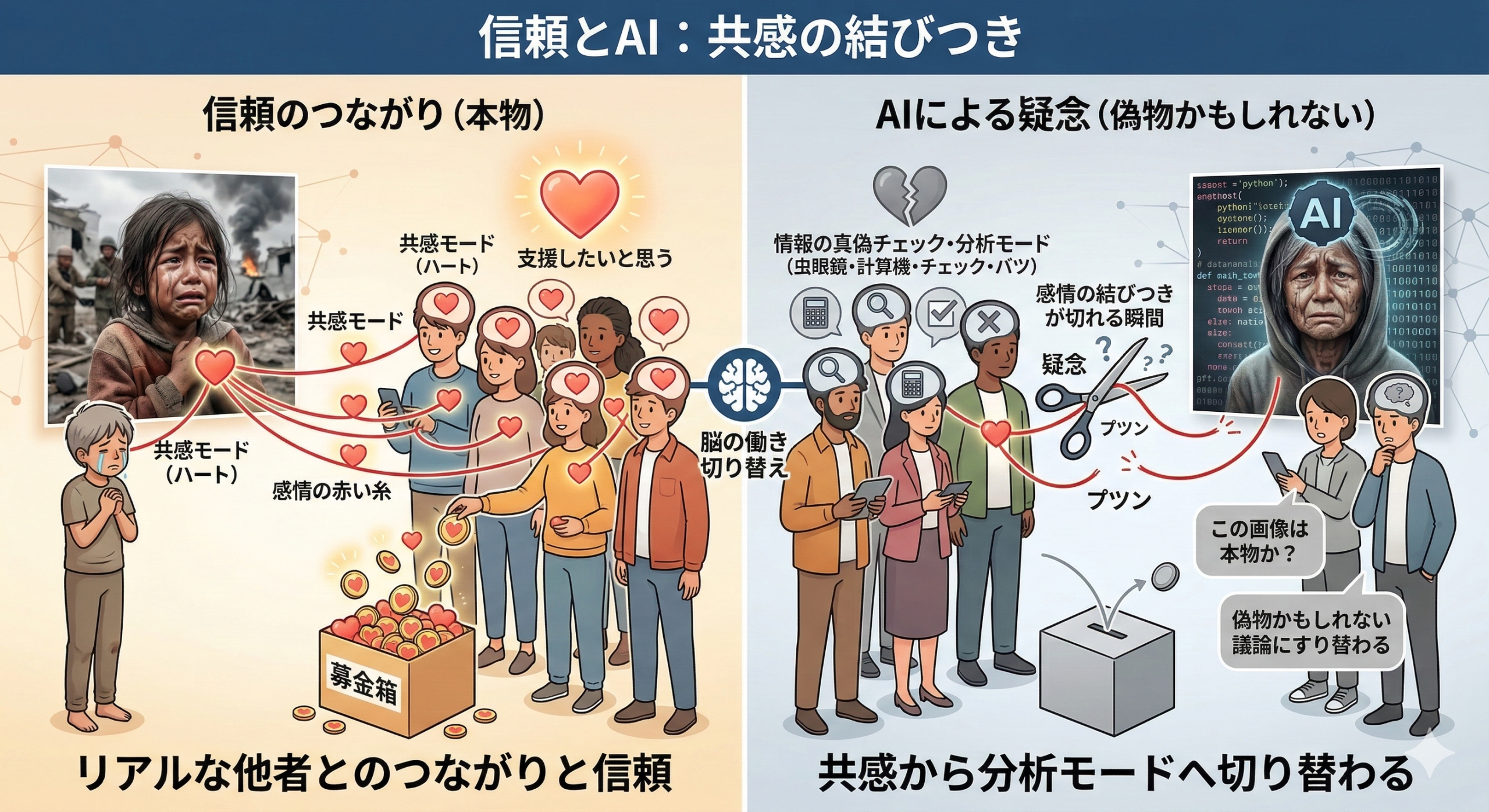

「感情の結びつき」が切れる瞬間

僕たちが「誰かを助けたい」と思うとき、そこには必ず「リアルな他者とのつながり」と「信頼」があるんだよ。「本当に困っている人がそこにいる」と信じられるからこそ、心が動かされて、自分のお金や時間を分けてあげようという行動につながるんだよね。これは人間の社会性を支える大切な本能みたいなものなんだ。

でも、目の前にある画像が「AIによって計算して作られたものかもしれない」と疑った瞬間、その「感情的な結びつき(エモーショナル・コネクション)」がプツンと切れてしまうんだ。心理学的に言うと、脳の働きが「他者への共感モード」から「情報の真偽をチェックする分析モード」に切り替わっちゃうんだね。だから、支援の話題ではなく「この画像は本物か偽物か」という議論にすり替わってしまったわけ!

リアルからの逃避と受け取られるリスク

さらに、飢餓や病気といったすごくデリケートな問題でAI画像が使われると、「現実の厳しい状況から目を背けて、都合のいい綺麗な嘘を作っている」と受け取られかねない。もちろん、一部には「実際の被害者の顔を出さないから、プライバシーが守られて良いね」という肯定的な意見もあったけれど、多くの人にとっては「AIというフィルターを通すことで、生々しい人間の物語が霞んでしまった」と感じられたんだ。

効率やスピードを求めるあまりに「共感のショートカット」を使おうとした結果、慈善活動の土台である「社会との信頼関係」という一番大切なものを失うリスクを抱えてしまった。これは科学と人間の心理が交差するとても興味深い現象だよね!

研究の限界とこれからの未来

じゃあ、チャリティ団体はもう二度とAIを使っちゃダメなのかな?研究チームは「AIを完全に禁止すべきだと言っているわけではない」としっかり強調しているよ!大切なのは、AIの便利さに振り回されず、「人間の物語」を主役に据えた使い方をすることなんだ。

そのための具体的な解決策として、研究では未来に向けたこんな提案がされているよ。

- 倫理的なプロンプト・エンジニアリングの学習:広報チームが、偏見(バイアス)を含まない適切な画像生成の指示を出せるように、しっかりとトレーニングを行うこと。

- チャリティ専用AIツールの開発:テクノロジー企業と協力して、人道支援の現場に特化した「ステレオタイプ警告機能」や「バイアス検出機能」を持った安全なAIを作ること。

- 現地コミュニティとの共創(コ・クリエーション):ただAIに描かせるだけでなく、支援先の現地の人たちと一緒にプロンプトを考え、完成した画像が文化的に正しいかを確認し合うプロセスを作ること。

こうやって、「テクノロジーの力」と「人間の真実性」のバランスをしっかり取ることが、これからの時代に信頼を保ち続けるためのカギになるんだね!

TKちゃんのまとめ!科学と心はつながっている!

というわけで、今回は「チャリティにおけるAI画像と共感の落とし穴」について紹介したよ!

AIは魔法の杖みたいに便利だけど、「人の心を動かすのは、やっぱり人間のリアルな物語なんだ」っていうことが、最新の調査データから浮き彫りになったのはすごく面白いよね!

テクノロジーがどんなに進化しても、僕たち人間が持っている「誰かを思いやる心」や「本物を求める直感」は、そう簡単にハックできるものじゃないんだ。科学技術は、そのリアルな思いをサポートするために使われてこそ、本当に輝くんだと僕は思うな!

みんなは、AIが作った画像を見て、心を動かされたことはある?それとも「フェイクかも」って無意識に分析モードに入っちゃう?ぜひ、周りの友達や家族とも「これからのAIとの付き合い方」について話してみてね!それじゃあ、次回のTKちゃんの科学実験ラボでまた会おうね!バイバーイ!

ソース:EurekAlert!

コメント