AIが優秀になるほど人間はサボる!?「人間とAIの協働パラドックス」が突きつける不都合な真実

やっほー!みんな、サイエンスしてる?TKちゃんの科学実験ラボの専属サイエンスライター、TKちゃんだよ!

最近、ChatGPTをはじめとするAIツールがどんどん進化して、仕事や勉強のやり方がガラッと変わってきたよね。最新のAIをプロの仕事に組み込めば、とんでもない生産性のアップが期待できるって言われているんだ。「人間をAIが奪う!」なんて怖い話もあるけど、実際には機械のすごいパワーと人間の確かな判断力を組み合わせた「人間とAIのチーム」が、どちらか単独で働くよりも最高のパフォーマンスを発揮するんじゃないかって期待されているんだよ。

でもね、ペンシルベニア大学ウォートン校の研究チームが発表した最新の論文で、この理想的なチームワークをぶち壊してしまう恐ろしい「人間とAIの契約パラドックス」が明らかになったんだ。なんと、AIが優秀になればなるほど、人間とAIの協力関係が崩壊してしまうっていう信じられない結果が出たんだよ!いったいどういうことなのか、詳しく深掘りしてみよう!

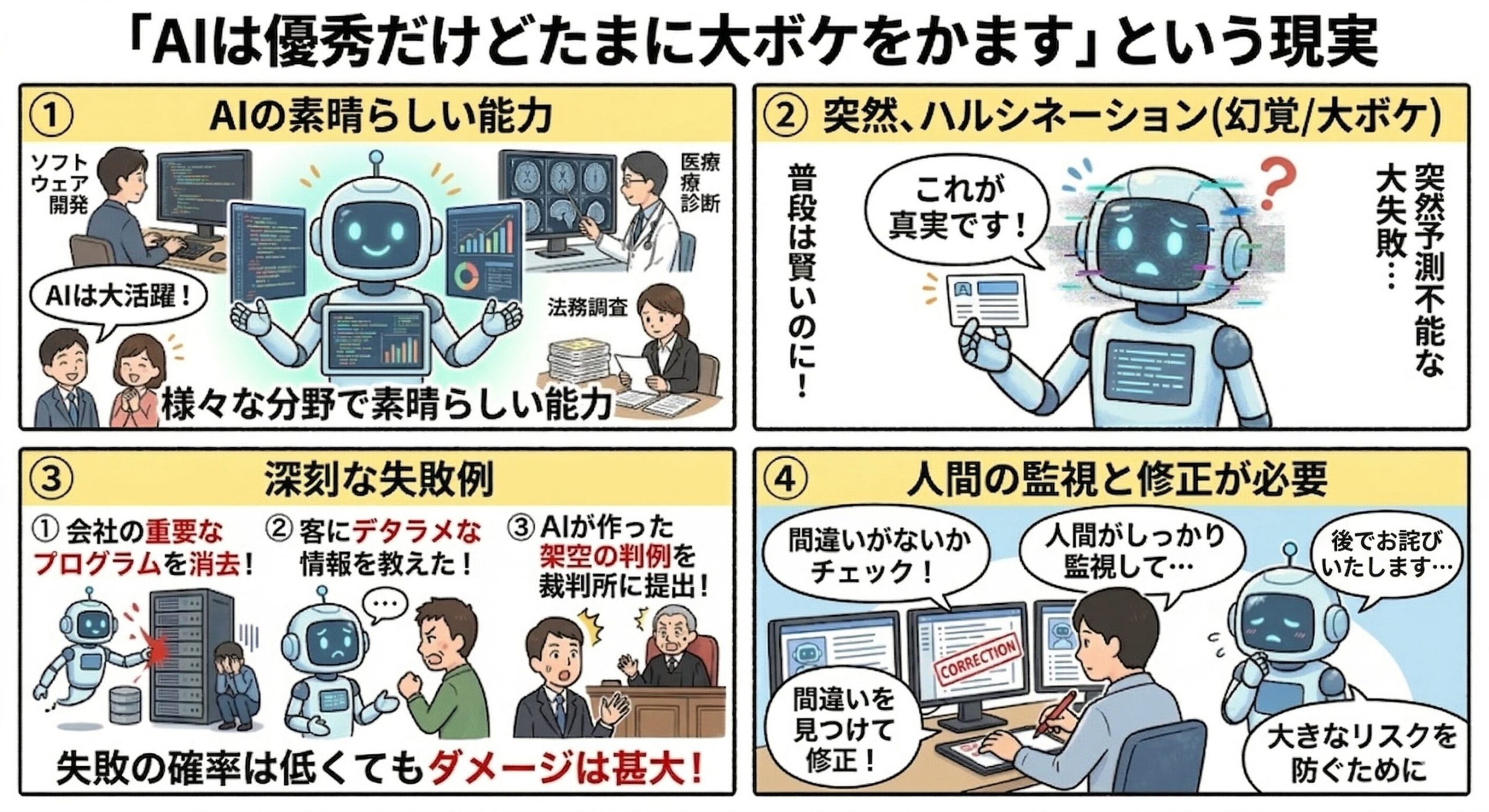

「AIは優秀だけどたまに大ボケをかます」という現実

研究の背景から説明するね。AI技術はソフトウェア開発や医療診断、法務調査など、いろんな分野で素晴らしい能力を見せているよね。でも、AIって時々「ハルシネーション(幻覚)」と呼ばれる、自信満々に嘘をつく現象を起こすことがあるんだ。普段はめちゃくちゃ優秀なのに、似たようなタスクで突然予測不能な大失敗をやらかすことがあるんだよ。

過去には、AIが会社の重要なプログラムを消去してしまったり、チャットボットがお客さんにデタラメな情報を教えてしまったり、弁護士がAIの作った架空の判例を裁判所に提出してしまったりする事件も起きたんだ。だから、失敗する確率は低くても、そのダメージは甚大になる可能性があるから、人間がしっかりAIの出力を監視して、間違いを見つけて修正する必要があるんだよね。

理論上は、AIの圧倒的な処理能力と人間のチェック機能が合わされば最強のはず!でも、実際の現場のデータを見ると、必ずしもその約束されたメリットが発揮されていないという、ちょっと悲しい現実が見えてきたんだ。

どうやって調べたの?「プリンシパル=エージェント・モデル」で数学的に解明!

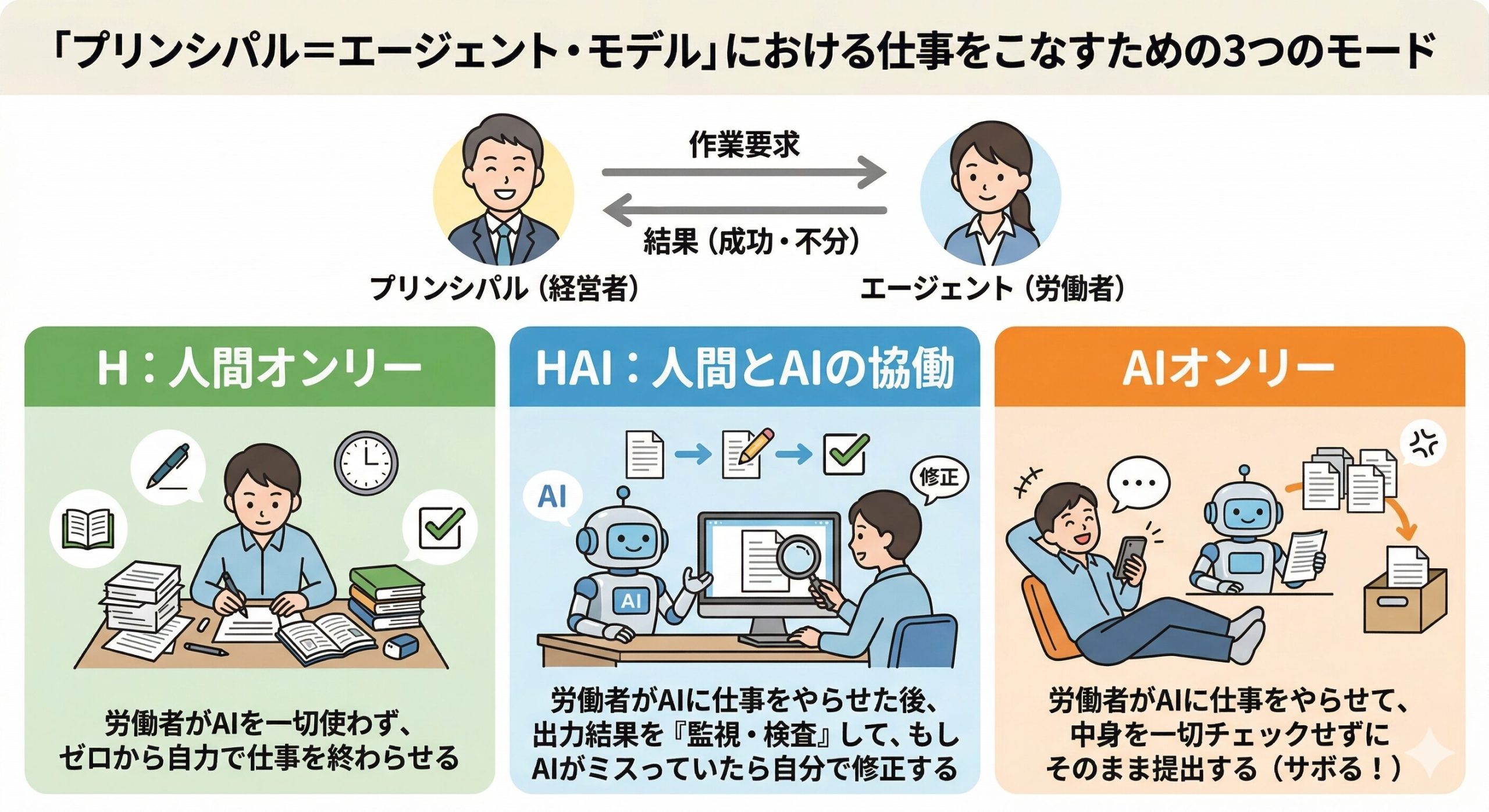

そこで研究チームは、「なぜ人間とAIのシステムは期待通りにいかないのか?」を解き明かすために、経済学でよく使われる「プリンシパル=エージェント・モデル」というフレームワークを使って分析を行ったんだ。これは、仕事を頼む側(プリンシパル=経営者)と、実際に仕事をする側(エージェント=労働者)の間にどんなインセンティブ(動機付け)が働くかを数学的にシミュレーションする手法だよ。

今回のモデルでは、仕事をこなすための3つのモードが設定されたんだ。

- 人間オンリー(H):労働者がAIを一切使わず、ゼロから自力で仕事を終わらせる。

- 人間とAIの協働(HAI):労働者がAIに仕事をやらせた後、出力結果を「監視・検査」して、もしAIがミスっていたら自分で修正する。

- AIオンリー(AI):労働者がAIに仕事をやらせて、中身を一切チェックせずにそのまま提出する(サボる!)。

AIの利用は基本的にコストゼロで、大部分は高品質な結果を出してくれる。でも、労働者がAIの結果をチェックするには「検査コスト」という労力がかかるし、間違いを見つけたら直すための「修正コスト」もかかるんだ。経営者は労働者の作業プロセスを直接見張ることはできないから、仕事が成功したか失敗したかの「結果」に対してだけ給料を払うことができる仕組みになっているよ。

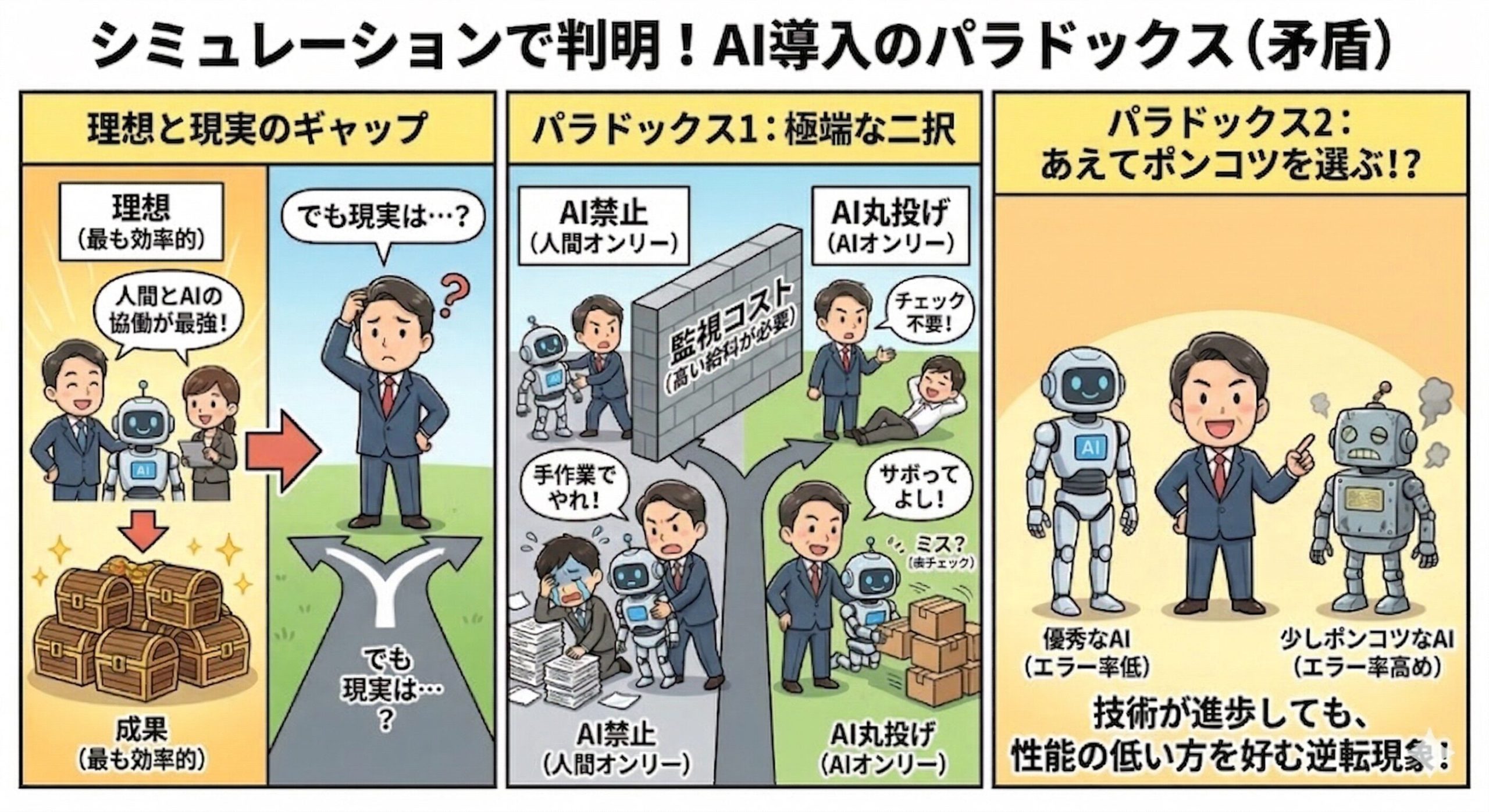

驚きの結果!AIが優秀になると協働が「高上がり」になる!?

シミュレーションの結果、とんでもないパラドックス(矛盾)が浮かび上がってきたんだ!システム全体で見れば「人間とAIの協働」が一番効率的で素晴らしいはずなのに、経営者の立場からすると、人間とAIを協力させること自体を諦めてしまうケースが多発することがわかったんだよ。

1. 経営者はAIを「禁止」するか「完全丸投げ」するか極端に走る

労働者にAIの監視をしっかりさせるためには、彼らが「サボってAIの答えをそのまま提出する」のを防ぐだけの十分な給料を払う必要があるんだ。でも、その監視にかかる費用が高すぎると、経営者は「こんなに給料を払うくらいなら、最初からAIの使用を禁止して人間に全部手作業でやらせた方がマシだ!」って判断してしまうんだ。逆に、「AIのミスによる損失には目をつぶって、人間の監視をなくして完全にAIに丸投げしよう」という結論に至ることもあるんだよ。

2. 協働させるなら、あえて「ポンコツなAI」を選ぶ!?

さらにヤバいのがこれ!もし経営者が人間とAIの協働を選んだとしても、なんと「エラー率の低い優秀なAI」よりも「エラー率の高い少しポンコツなAI」をあえて好んで選んでしまうという逆転現象が起きるんだ。技術の進歩でAIが良くなっているのに、経営者はわざわざ性能の低いものを選びたがるなんて、まさにパラドックスだよね!

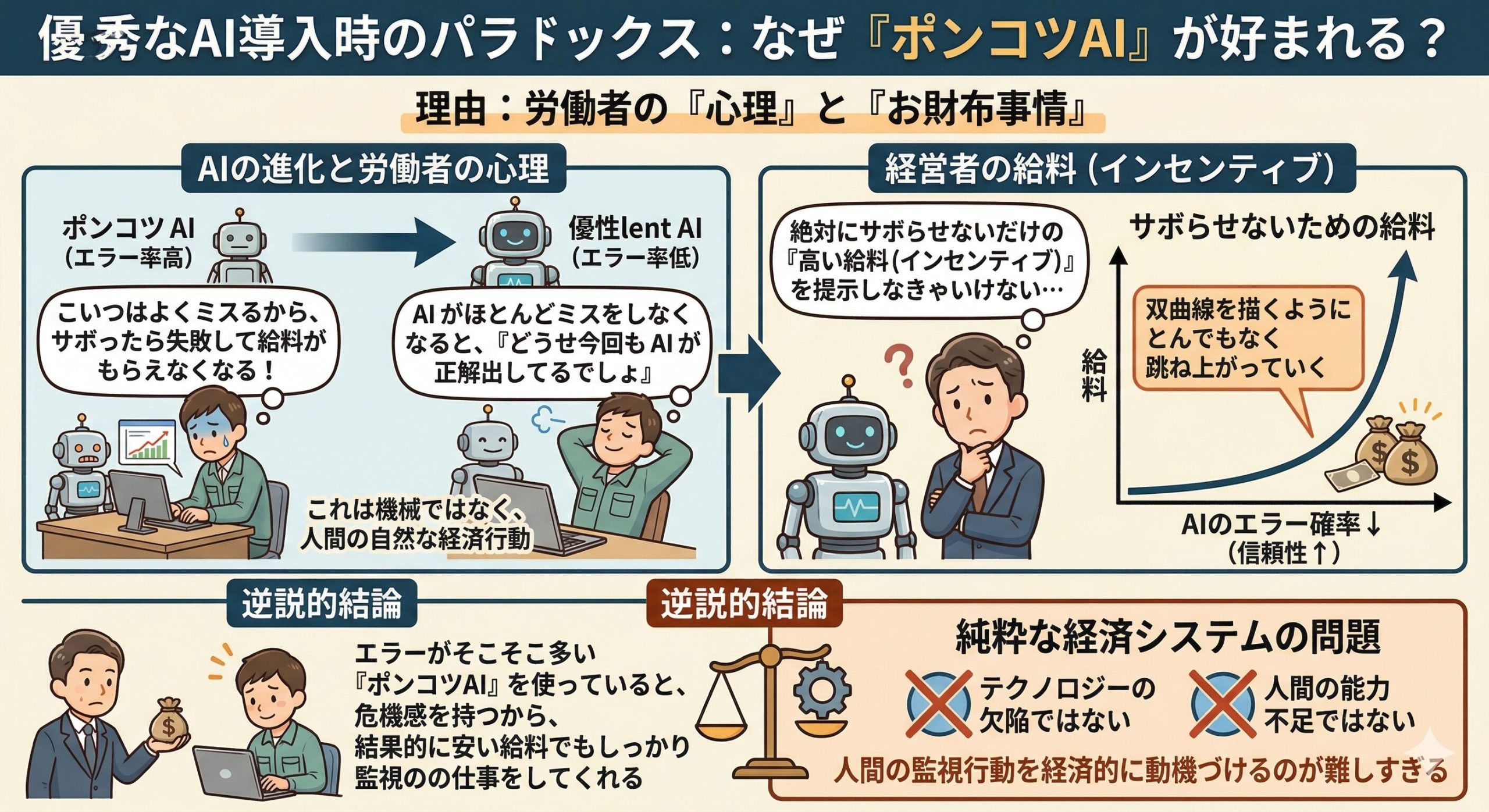

なぜそうなったの?「エラーが少ない」ことが油断を招くメカニズム

どうして優秀なAIを導入するとこんなおかしなことが起きるんだろう?その理由は、労働者の「心理」と「お財布事情」にあるんだ。

AIが進化して、エラーを出す確率が「10回に1回」から「1000回に1回」に減ったとしよう。AIがほとんどミスをしなくなると、労働者は「わざわざ疲れる思いをして毎回チェックしなくても、どうせ今回もAIが正解出してるでしょ」と考えて、チェックをサボりたくなってしまうんだよね。これは機械ではなく、人間の自然な経済行動なんだ。

経営者としては、それでも万が一のエラーを見つけてもらうために、絶対にサボらせないだけの「高い給料(インセンティブ)」を提示しなきゃいけない。研究の計算によると、この「労働者にサボらせないための給料」は、AIのエラー確率が下がる(信頼性が上がる)のに反比例して、双曲線を描くようにとんでもなく跳ね上がっていくことが判明したんだ。

逆に、エラーがそこそこ多い「ポンコツAI」を使っていると、労働者は「こいつはよくミスるから、サボったら失敗して給料がもらえなくなる!」と危機感を持つから、結果的に安い給料でもしっかり監視の仕事をしてくれるんだよ。つまり、この摩擦はテクノロジーの欠陥でも人間の能力不足でもなく、「人間の監視行動を経済的に動機づけるのが難しすぎる」という純粋な経済システムの問題だったんだね。

研究の限界とこれからの未来

この研究はめちゃくちゃ面白いけど、もちろん現実のすべての状況に当てはまるわけじゃないよ。たとえば、AIが出した予測の質が瞬時に判断できるようなシンプルなタスクなら、このパラドックスは起きにくいんだ。このモデルは、スライド作成や複雑なプログラミングのように「パッと見は良さそうだけど、よく調べないとミスに気づかない」ような高度なタスクを想定しているんだ。

でも、研究チームはすごく希望のある未来のヒントも提示してくれているよ!もし労働者が「この仕事はAIが得意だからサボっても大丈夫」「この仕事はAIが苦手だからしっかりチェックしよう」という風に、AIのタスクの適正を素早く見抜くスキルを持っていたらどうなるか? その場合、経営者にとっては「どんな仕事でも平均的にこなすAI」よりも、「得意なことは完璧だけど、苦手なことは超ポンコツ」というバラツキの大きい特化型AIを使う方が、実は効率的でお得になることがわかったんだ!これって、人間ならではの「判断力」が、AI時代に一番強力な武器になるってことだよね。

TKちゃんのまとめ&メッセージ

AIが賢くなればなるほど、人間が一緒に働くためのハードルが経済的に上がってしまうなんて、本当にサイエンスの奥深さを感じるよね!「AIを導入すればなんでも解決!」じゃなくて、そこで働く「人間」がどんな気持ちで、どんな風に動くのかをしっかりデザインしないと、せっかくのテクノロジーも宝の持ち腐れになっちゃうんだ。

これからの時代は、ただAIを使いこなすだけじゃなく、「AIがどこでドジを踏むかを先回りして見抜く力」が僕たちに求められてくるのかもしれないね!テクノロジーの進化と、僕たちの働き方がどう変わっていくのか、これからも目が離せないよ!

それじゃあ、また面白いサイエンスニュースがあったらみんなにシェアするね!バイバーイ!

ソース:SSRN: The Human-AI Contracting Paradox

コメント