ドローンの「空の目」とAIの「想像力」がタッグを組んだ!

みんな、やっほーっ!サイエンスのワクワクを全力でお届けするサイエンスライターの僕、TKちゃんです!キミは、地震などの大きな災害が起きたとき、テレビのニュースでドローンが上空から撮影した映像を見たことはないかな?広範囲の状況が一目でわかってすごいよね。でも実は、ドローンの映像だけでは「建物の1階部分がどう潰れているか」や「壁にどれくらい危険なヒビが入っているか」といった、地上レベルの細かなダメージまでは見えにくいという弱点があったんだ。

かといって、崩れかけた建物が並ぶ危険な街の中に、すぐに調査員が入って一つ一つ写真を撮って回るのは時間がかかりすぎるし、とっても危険だよね。そこで今回紹介するのは、なんと「上空からの画像」を元にして、最新の画像生成AIが「地上から見たら建物がどう壊れているか」を超リアルに推理して描き出してしまうという、まるでSF映画みたいな最先端の研究なんだ!

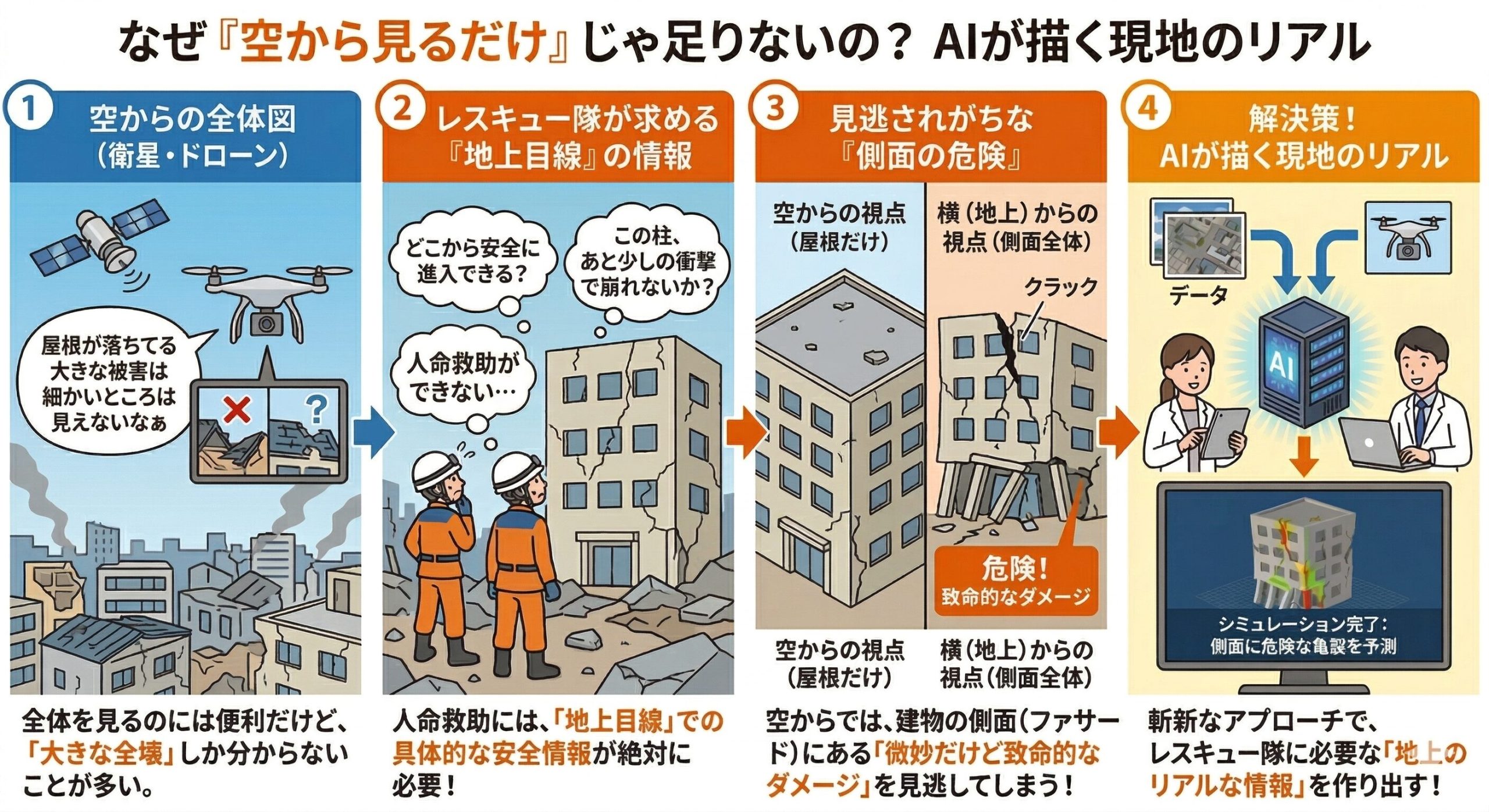

なぜ「地上の様子」を知ることがそんなに大切なの?

そもそも、どうして空から全体を見るだけじゃダメなんだろう?それは、レスキュー隊が人命救助を行うためには、「どこから建物に進入できるか」「あと少しの衝撃で完全に倒壊してしまわないか」といった、地上目線での具体的な情報が絶対に必要だからなんだ。建物のダメージには、完全にペチャンコに潰れてしまう「全壊」だけでなく、柱が少し傾いているだけの状態や、壁に致命的な亀裂(クラック)が入っている状態など、色々なパターンがあるよね。

これまでの人工衛星やドローンを使った分析では、屋根が落ちているような大きな被害はわかっても、建物の側面(ファサード)に起きた微妙なダメージを見逃してしまうことが多かったんだ。そこで研究チームは、「データが足りないなら、AIにリアルな被災状況をシミュレーションさせればいいじゃないか!」という、とっても斬新なアプローチに挑戦したんだよ。

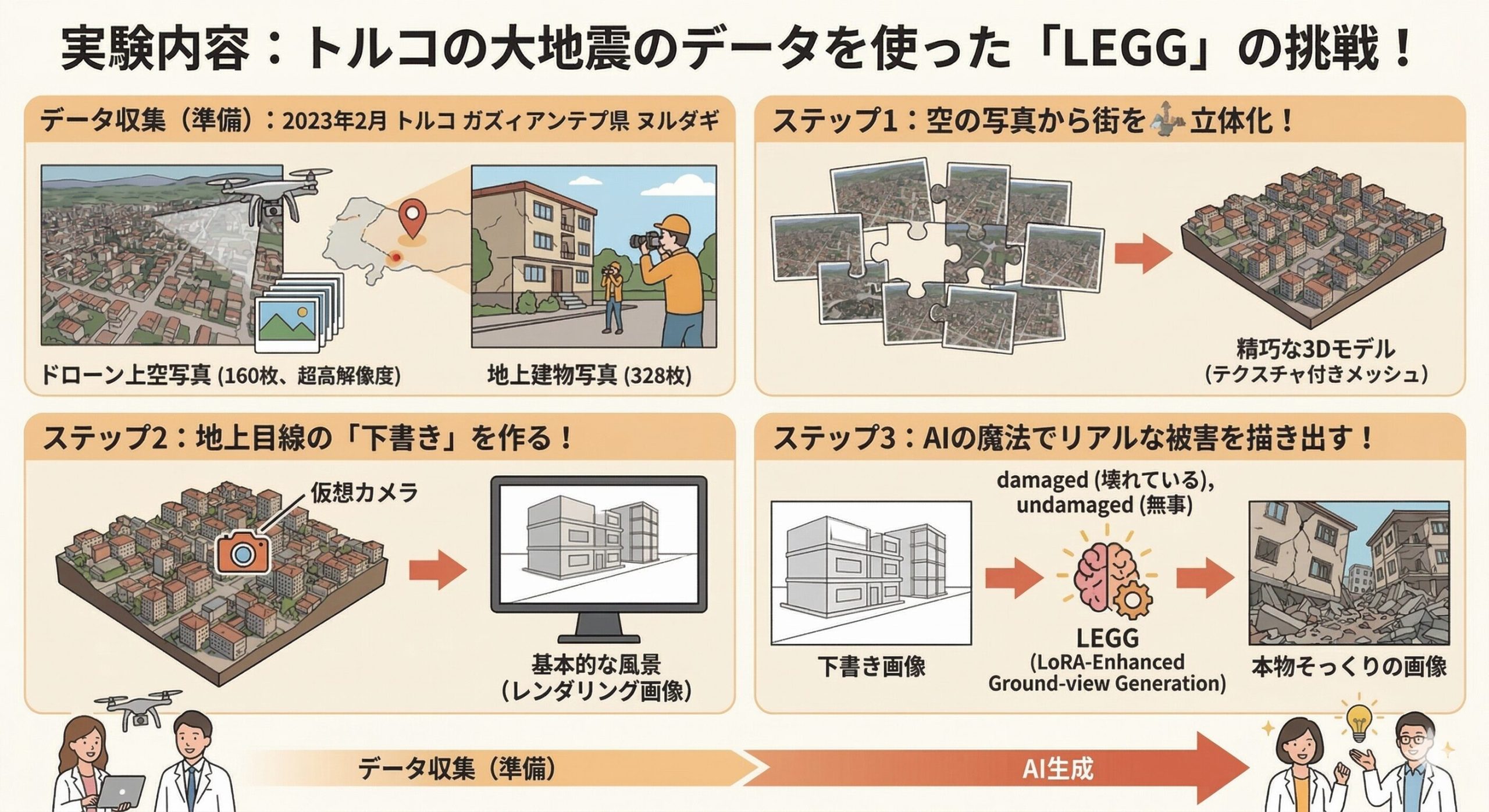

実験内容:トルコの大地震のデータを使った「LEGG」の挑戦!

この研究では、2023年2月にトルコで発生したマグニチュード7.8の大地震で甚大な被害を受けた、ガズィアンテプ県の「ヌルダギ」という街のデータが使われたんだ。研究チームは、地震発生のわずか2日後にドローン(UAV)で撮影された160枚の超高解像度な上空写真と、調査チームが地上で撮影した328枚の実際の建物の写真を用意したよ。

魔法のステップはこうやって進む!

ステップ1:空の写真から街を立体化! ドローンで撮ったたくさんの写真をつなぎ合わせて、街全体の精巧な3Dモデル(テクスチャ付きメッシュ)を作り上げるんだ。

ステップ2:地上目線の「下書き」を作る! 作った3Dモデルの中に仮想のカメラを置いて、「もし地上からこの建物を見上げたら、大体こんな形に見えるはず」という基本的な風景(レンダリング画像)を切り出すよ。

ステップ3:AIの魔法でリアルな被害を描き出す! ここでいよいよ、研究チームが開発した「LEGG(LoRA-Enhanced Ground-view Generation)」というAIモデルの出番!先ほどの下書き画像と一緒に、「damaged(壊れている)」や「undamaged(無事)」というキーワード(テキストプロンプト)をAIに入力すると、建物のヒビや瓦礫まで本物そっくりに描き出してくれるんだ!

驚きの結果:本物と見間違えるほどのクオリティ!

AIが描き出した画像は、驚くほどリアルだったんだ!ただ単に建物をぐちゃぐちゃにするのではなく、一部だけが崩落している様子や、建物の壁面に走る細かな亀裂まで、実際の地震被害の特徴を見事に捉えていたんだよ。研究チームは、AIが作った画像がどれくらい現実のデータに近いかを、4つの厳しいテスト(PSNR、SSIM、LPIPS、FID)で採点したんだ。

その結果、LEGGはベースとなった通常の画像生成AIをすべての項目で上回ったんだ!例えば、画像の正確さを測る「PSNR」というテストでは「19.82」という高い数値を出し、人間の見た目にどれくらいリアルに感じるかを測る「FID」というテストでは「66.06」という素晴らしい成績を叩き出したよ。さらにすごいのは、ただ壊れている絵を描くだけじゃなくて、「トルコの街並み」という地域特有の建築デザインや雰囲気まで、しっかり再現できていたことなんだ!

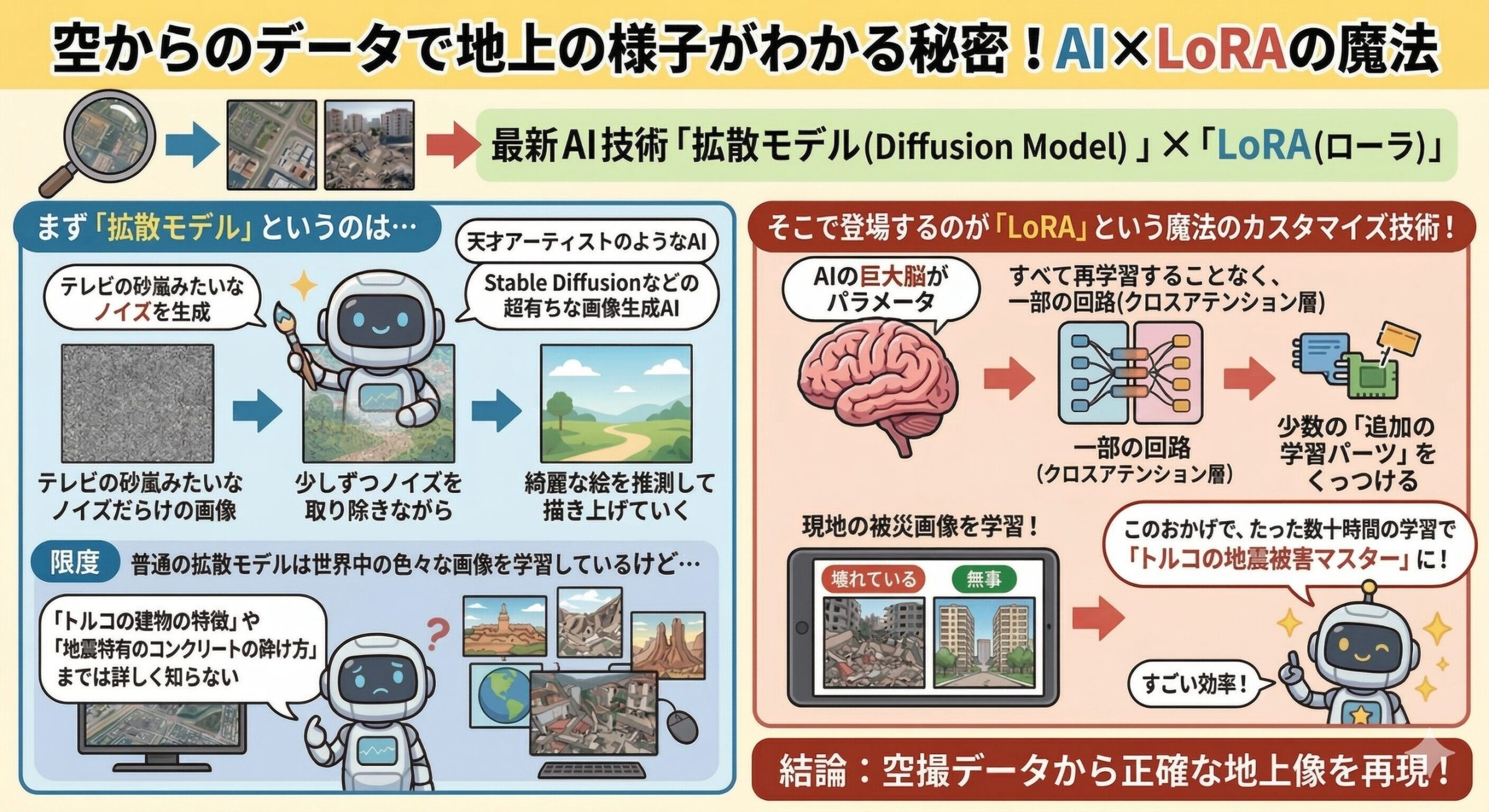

なぜそんなことができるの?最新AIの秘密に迫る!

空からのデータだけで、どうして地上の様子がこれほど正確にわかるんだろう?その秘密は、最新のAI技術である「拡散モデル(Diffusion Model)」と「LoRA(ローラ)」の組み合わせにあるんだ!ここから少しディープな科学の話になるけど、しっかりついてきてね!

まず「拡散モデル」というのは、Stable Diffusionなどの超有名な画像生成AIで使われている仕組みのこと。テレビの砂嵐みたいな「ノイズだらけの画像」からスタートして、少しずつノイズを取り除きながら綺麗な絵を推測して描き上げていく天才アーティストのようなAIなんだ。でも、普通の拡散モデルは世界中の色々な画像を学習しているから、「トルコの建物の特徴」や「地震特有のコンクリートの砕け方」までは詳しく知らないんだよね。

そこで登場するのが「LoRA(Low-Rank Adaptation)」という魔法のカスタマイズ技術!これは、AIの巨大な脳みそ(パラメータ)を最初から全部作り直すのではなく、一部の回路(クロスアテンション層)だけに少数の「追加の学習パーツ」をくっつける技術なんだ。研究チームは、現地で撮られた実際の被災画像を「壊れている」「無事」というラベルと一緒にこのLoRAでAIに教え込んだんだよ。このおかげで、たった数十時間程度の学習時間で、AIは「トルコの地震被害マスター」に生まれ変わることができたというわけ!すごい効率だよね!

研究の限界と、これからの未来

もちろん、科学の探求に終わりはないから、この技術にもまだ乗り越えるべき壁はあるよ。一番の課題は、生成AI特有の「ランダム性」だね。AIはあくまで「これまでのデータから考えて、確率的に一番ありえそうな画像」を作っているだけだから、現実の建物とは違うヒビを描いてしまったり、実際には割れていない窓ガラスを割れているように描いてしまう(ハルシネーションのような)可能性もゼロではないんだ。

また、今のAIは「ダメージがある」か「ない」かという大まかな指示で動いているけれど、将来的には「ここに瓦礫が散乱している」「外壁だけが剥がれ落ちている」みたいに、もっと細かい指示(プロンプト)でコントロールできるようになれば、さらに実用的になると期待されているよ。災害直後は使える写真データが極端に少ないから、ほんの少しの画像からでも正確に推測できる技術へと進化していくことが目標なんだ。

TKちゃんのまとめ!サイエンスは命を救う道標だ!

いかがだったかな?空から撮ったデータとAIの想像力を組み合わせることで、誰も立ち入れない危険な被災地の「地上から見た景色」を安全に作り出すことができるなんて、本当に画期的なアイデアだよね!この技術がもっと進化して世界中のレスキューチームで使われるようになれば、「この通りは1階が潰れている可能性が高いから、重機を優先的に手配しよう!」とか、「ここは壁が傾いているから別のルートから救助に向かおう!」といった作戦を、現地に到着する前から立てられるようになるかもしれないんだ。

AI技術はただ絵を描いて遊ぶだけのものではなくて、僕たちの社会をより安全に、そして災害に強くするための強力なパートナーになれるんだね。サイエンスの力で未来の命を救う、そんな素敵な研究にこれからも大注目していこう!それじゃあ、また次回の「科学実験ラボ」で会おうね!バイバイ!

コメント